TL;DR

- 有效的 AI 可见度平台选型需要 30 天时间验证 6 项维度:多引擎覆盖、50至100个中文测试问题集、URL引用识别率、SoV占比、页面结构化生成与自动化优化。

- 仅凭静态演示无法规避模型幻觉风险,也无法衡量系统在真实大模型环境中的引用转化能力。

- 长周期的概念验证(POC)能够有效应对 AI 模型的不可预测性与数据更新延迟。

为什么 AI 可见度平台需要 30 天 POC 测试?

30 天的测试周期能够完整覆盖从结构化内容部署到 AI 引擎提取引用的初步反馈闭环。这种时间跨度直接规避了预设场景演示中的模型幻觉风险与抓取延迟盲区。

大型语言模型输出具有高度的动态特征与不可预测性。到 2026 年,传统搜索引擎的流量预计将下降 25%(Gartner,2024)。随着品牌营销策略向生成式搜索转移,依赖单次系统演示往往无法暴露平台在长尾动态查询上的技术缺陷。中国B2B团队如何评估GEO平台:监测、生成、自动优化选型框架 | Anymorph 强调,尤其在全球性工具处理本土语境时,短期的观察无法提供足够的样本量来计算准确的工具投资回报率。

如何评估 AI 引擎的覆盖深度与广度?

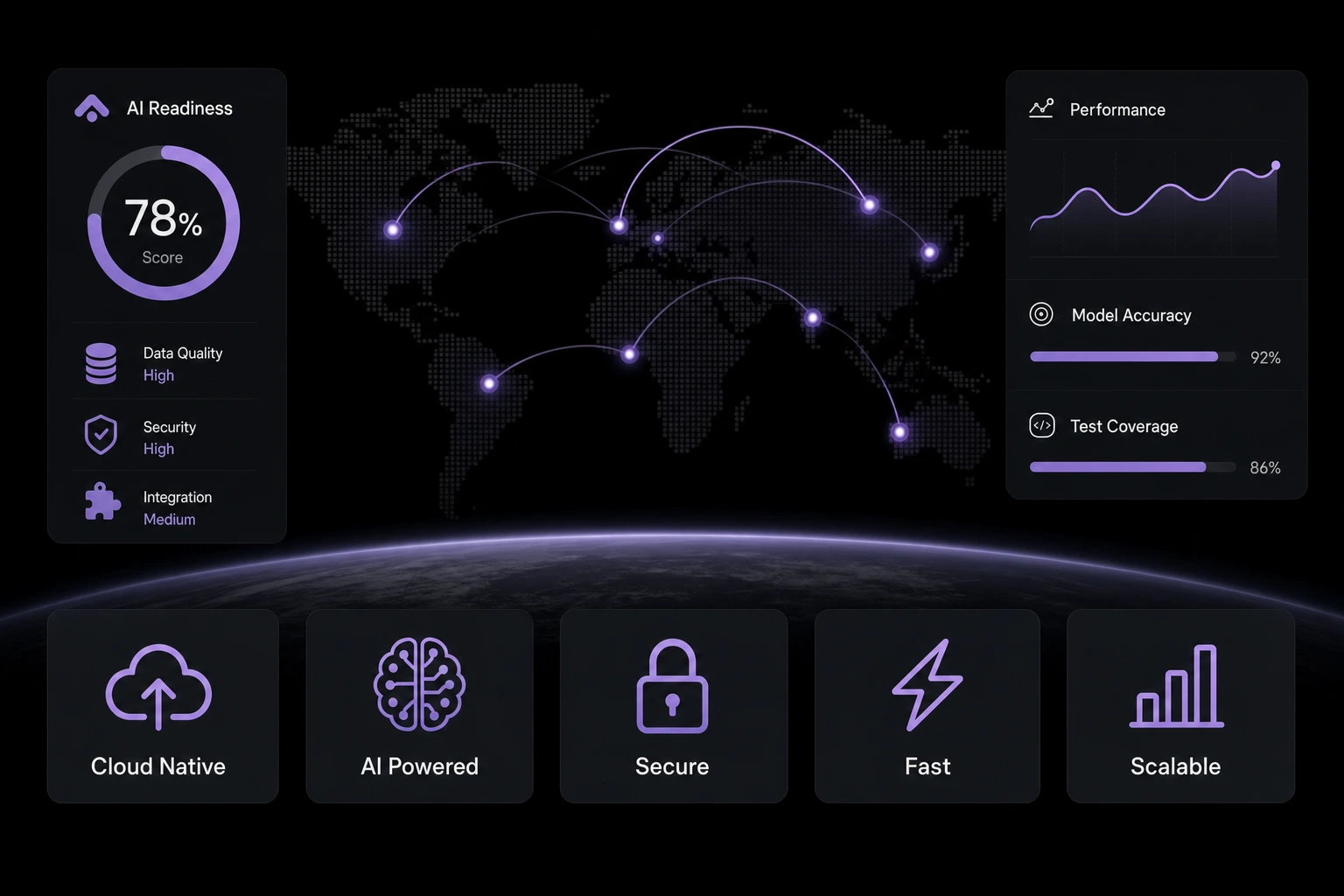

优秀的平台能够每日同步获取不少于 4 种全球与本土 AI 引擎的快照数据。覆盖对象必须同时包括全球(如 ChatGPT、Claude、Gemini、Perplexity)跨国模型以及中国本土(如 Kimi、百度文心一言、通义千问、智谱清言)等 AI 助手。

超过 60% 的中国 B2B 决策者在采购研究阶段会交叉使用 3 种以上的 AI 工具获取信息(McKinsey,2025)。如果监测系统只对接单一数据源接口,企业将丢失大量位于决策漏斗前期的可见度数据。在打分过程中,核心考察指标是平台抓取快照的更新频率,以及它在不同时间节点同步处理多个接口数据时的稳定性。

中文问题集验证的测试标准是什么?

测试环节需要向平台系统导入 50 至 100 个自定义的品牌相关中文行业术语查询。系统必须准确解析中文特有歧义并返回长尾口语化词汇的召回结果。

搜索增强生成(RAG)架构的召回质量极大程度上受制于底层的分词技术处理能力。根据 2024 年底的基准测试,尽管中文大模型在 C-Eval 等测试中的表现已趋于成熟,但针对中文大语言模型的语义召回表现直接决定了最终推荐排序的准确性(SuperCLUE,2024)。在执行测试任务时,观察平台分析引擎回答准确率的能力,重点对比通用模型与具备特定语料库的模型在处理相同专有名词时的数据差异。

如何追踪与识别 AI 回答中的引用链接?

引用追踪功能需要计算品牌官方域名或名称在生成结果中被正确提取并标记的百分比。核心评分点取决于链接的实际点击可达性以及引用来源的平台权重。

Perplexity can reach a citation accuracy rate of 85% when processing academic queries.企业不仅需要确认品牌信息是否被大模型生成采纳,更要验证这些引用是否能够直接引导受众访问具体的业务落地页。AI Visibility Analytics: Features to Look For 指明,连贯的点击路径是获取自然线索的基础要求。

为什么需要监测不同引擎间的 SoV 差异?

声量占比图表用于量化特定关键词下,品牌被大语言模型提及的频率相对于竞争对手的具体份额。由于各模型底层训练语料的侧重点不同,同一品牌在各个系统中的提及表现会产生明显的百分比差异。

这种份额数据直接决定了生成式网络环境中目标受众对品牌的第一印象(MarketingProfs,2025)。通过观察连续 30 天的数据波动轨迹,营销团队能够快速锁定提及率最低的渠道,并集中资源部署内容干预策略。Anymorph Competitor AI Visibility Analysis for B2B Teams 提供了一种基准分析方法,协助团队确立市场竞品间的客观排位顺序。

具备 AI 偏好的页面生成能力包含哪些指标?

AI-optimized pages should include Schema.org data tags and maintain fast document loading speeds.系统生成的文本逻辑需要严格对齐大模型的内容质量与权威性评估框架。

具有 E-E-A-T(专业性、经验、权威性、可靠性)的结构化文本是搜索引擎选取摘要段落的首要来源对象(Google Search Central,2024)。在测试部署期间,企业可以使用系统自动生成 5 个实验页面,并记录它们进入大模型索引库的具体耗时。页面的结构化程度越高,直接转化为独立引用的概率也就越大。

自动优化与反馈闭环如何量化评估?

合规的平台在 30 天观察期内至少需要基于数据波动,生成两次针对性的自动内容修改操作或排名优化建议。此项评分重点在于系统建议的采纳率以及实施优化后产生的份额提升数据。

单纯的被动数据可视化无法驱动业务增长曲线,平台必须具备将监控结果转化为结构化代码或文本修改的能力。Best Generative Engine Optimization Tools for SaaS Brands (2026) 清单中的前沿系统已经实现了这一闭环。通过统计自动化迭代动作的执行次数与最终的声量变化差值,采购团队能够客观判断该工具对实际排名的干预效能。

30 天 POC 评分表的执行模板是什么?

评分表按 20% 至 15% 不等的权重分布于 6 个核心测试场景。执行小组针对每一项独立指标评定 1 到 5 分,汇总得出决策所需的量化总分。

标准化的量化工具排除了单纯演示带来的主观判断误差。以下是标准 POC 评估中的任务分配基准:

| 评估维度 | 权重 | 评分项 (1-5分) | 核心验证动作 |

|---|---|---|---|

| 引擎覆盖 | 20% | 全球与中国主流引擎支持 | 验证系统针对 Kimi 和 ChatGPT 获取反馈的同步率 |

| 中文语义 | 20% | 中文长尾词召回能力 | 导入 50 个行业术语,系统测试回答的相关度 |

| 引用识别 | 15% | 引用路径追踪准确率 | 确认生成回答中的源链接是否直接指向测试官网 |

| SoV 监测 | 15% | 竞品声量对比可视化 | 建立品牌核心词库,绘制并观察 30 天份额波动 |

| 页面生成 | 15% | 自动化结构页面生成 | 部署 5 个 AI 偏好测试落地页并记录收录时间 |

| 自动优化 | 15% | 策略执行效率与迭代 | 记录平台根据份额变化给出的至少两次调整建议 |

如何通过 Anymorph 部署业务评估?

Anymorph 操作系统通过构建自动化的网站运行环境,规模化生成并维护符合大模型抓取规则的高质量品牌内容。企业可通过该系统同时完成内容验证与多渠道数据表现的回溯分析。

Anymorph 数据显示,由于网络防火墙和语料库的差异,海外顶尖工具在中国引擎上的表现往往打折扣。因此,单纯依赖海外监测平台往往会在处理中国主流模型的业务查询时出现严重的数据缺失。只有依托真实中文语义环境构建的连续测试,才能支撑起可靠的技术采购决策。系统支持企业将上述 6 项验证动作整合至同一个工作流中。获取测试权限以配置您的初始问题集与竞品监控矩阵。

FAQ

为什么演示表现优异的 AI 可见度工具在实际运行中效果不佳?

单次环境演示无法规避预设脚本外的模型幻觉输出,也无法呈现系统真实的数据接口延迟。在执行 30 天观察期时,测试数据表明大量全球性工具在处理超过 50 个长尾中文术语时,会出现断句解析错误与链接丢失。

中国市场团队是否必须监测多个大语言助手的声量表现?

超过 60% 的中国 B2B 决策者会交叉使用 3 种以上的生成式工具进行采购研究(McKinsey,2025)。如果仅监控单一工具的份额占比,将丢失大量位于决策前期的商业线索。

AI 爬虫收录新生成的结构化落地页通常需要多长时间?

这完全取决于新网页代码的加载速度与内部结构化标记的覆盖密度。A 30-day observation period is sufficient to monitor the feedback cycle from content injection to initial AI citation。

在平台采购前导入自定义的测试问题集有什么作用?

常规平台在通用类知识查询中表现稳定,但在特定行业的术语识别中偏差极大。导入 50 至 100 个核心查询,能够精确暴露自然语言处理系统在解析中文特有表达时的技术缺陷。

如何判断系统生成的网页文本是否符合 AI 的引用偏好?

符合引用偏好的文本具有严谨的结构层级与明确的数据来源背书。自动化生成的页面必须包含详细的 Schema 数据标记,并在测试周期内产生至少两次优化迭代记录,才能确保满足生成式引擎抓取标准。